A internet não é um lugar tão bonito quanto os anúncios de bancos online nos dizem. Com dois ou três cliques em falso, você acaba baixando e executando um arquivo que não deveria. Pode ter suas informações bancárias roubadas, seus arquivos trancafiados por ransomware ou abrir as portas da sua rede pra alguém só querendo dar uma aloprada.

O ano de 2017, até agora, não foi tranquilo para quem trabalha com segurança da informação. Em maio, tivemos o ataque com o ransomware WannaCry que infectou computadores ao redor do mundo. Poucos meses depois, quando a poeira tinha baixado, veio mais um grande ataque Trancafiando sistemas atrás de chaves criptográficas praticamente impossíveis de ser decifradas, o surto de infecções do Petya abalou junho e deixou um alerta vermelho no ar. Será que dá para piorar?

Videos by VICE

Apesar do clima de preocupação rondando a internet o tempo todo, Stuart McClure — autor do livro Hackers Expostos e CEO da Cylance — está tranquilo. Em sua apresentação durante o Mind The Sec, evento de segurança da informação voltado para o pessoal responsável pela tomada de decisão nas empresas e governo, em São Paulo, McClure defendeu que, com a aplicação de Machine Learning nas defesas virtuais, a vida está começando a ficar bem mais fácil e segura.

Ainda em 2016, bem antes desses dois grandes ataques, as empresas apostavam no aumento da complexidade e no crescimento de casos com ransomware. Paralelamente, de forma um pouco mais discreta, a discussão sobre o aumento do uso da inteligência artificial para proteger sistemas ganhava força chamando menos atenção do que suas outras aplicações mais tradicionais da IA, como o mercado publicitário ou mais engraçadinhas como visitas guiadas a museus.

Embora as pesquisas neste campo sejam realizadas há algum tempo, o debate a respeito de sua aplicação à segurança só começou a esquentar nos últimos dois anos, quando resultados mais sólidos começaram a aparecer e a ganhar espaço no noticiário. Hoje, empresas tradicionais como Kaspersky, Symantec e IBM também estão oferecendo esta proteção feita por robôs.

McClure explica que, apesar da nova aplicação, a tecnologia é a mesma utilizada há décadas e se assemelha em muito aos algoritmos de empresas como Google e Facebook para oferecer publicidade. “Estamos em um ponto inédito: é a primeira vez que as equipes de segurança estão na frente dos caras maus”, afirma.

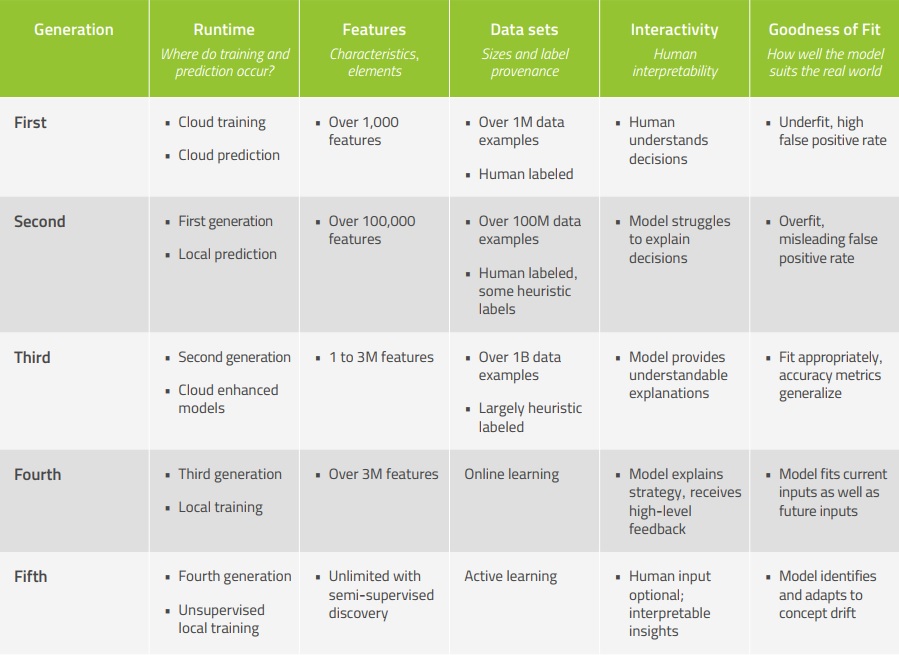

Apesar do otimismo, ele destaca que ainda estamos bastante longe de chegar ao estágio ideal desta tecnologia. O desenvolvimento das inteligências artificiais, segundo McClure, podem ser divididos em cinco gerações.

Nos primeiros estágios, as máquinas ainda dependiam muito da intervenção humana para funcionar corretamente e estavam muito sujeitas a erros e falsos positivos. Ele afirma que atualmente as IAs mais avançadas estão nos primeiros momentos da terceira geração. “Estamos caminhando para o desenvolvimento de uma inteligência artificial mais generalista (General Intelligence AI)”, diz. “O que nós temos hoje é uma inteligência artificial limitada (Narrow Intelligence AI), pegamos algo, a treinamos e ela consegue reconhecer o padrão daquela coisa.”

Um exemplo dessa inteligência artificial limitada são aplicações de identificação imagens que temos na internet, disponíveis desde antes de 2015. “No caso das IA generalistas, elas não apenas aprendem sozinhas, como também conseguem explicar as razões daquilo que aprenderam. Então acreditamos que a aplicação de IA na segurança passará por isso”, diz. “Sinto que ainda estamos distantes disso, no mínimo uns 5 anos.”

Apesar da aparente vantagem, McClure reconhece que a corrida armamentista no mercado de segurança da informação pode mudar o cenário atual em poucos anos. O raciocínio é simples: se inteligência artificial pode ser utilizada para proteger, ela também pode ser facilmente utilizada para atacar.

Diante deste quadro ele adota um tom tranquilizador. “Com certeza não veremos nada deste tipo nos próximos três anos. A partir daí consigo ver pessoas começando a impactar a nossa habilidade de pegá- los.”

Ele explica que muito provavelmente quem vai aparecer atacando com IAs são os grandes atores de sempre. “Governos como Estados Unidos, que são muito bons nisso, França, a China e o crime organizado, a máfia russa, por exemplo. Qualquer um desses pode oferecer um desafio real.”

Para ele, com o crescimento de complexidade, vamos começar a ver novos malware que utilizam técnicas antigas de maneiras bem mais agressivas. Uma dessas técnicas é a de escrever malwares polimórficos — que a cada execução têm seu código reescrito, de forma a aumentar muito sua detecção por sistemas de segurança. “Se eu tivesse que escrever uma arma contra a proteção oferecida pela inteligência artificial, seria um malware polimórfico baseado em inteligência artificial. Isso causaria uma dor de cabeça imensa, pois se você não pegar a primeira entrada, a primeira execução deste malware, pegá-lo depois seria incrivelmente difícil.”

As baixas da corrida armamentista digital

Como já falamos aqui em mais de uma ocasião, a automatização já começou a substituir trabalhadores humanos por robôs que fazem o trabalho de uma forma mais barata, mais rápida e com menores chances de enganos. Se o processo começou ainda na segunda metade do século XX, em fábricas onde o trabalho manual e repetitivo deu lugar a braços robôs, hoje a substituição começa a acontecer em outro nível e atingir áreas que não imaginávamos ser possível ter um robô trabalhando, como transportes e cargos de gerência.

Há alguns anos, motoristas profissionais começaram a vislumbrar a possibilidade de serem substituídos, em um futuro não muito distante, por carros autônomos. Hoje são os hackers que começam a ver esta possibilidade se desenhar no horizonte.

Para McClure, porém, o horizonte dos hackers não é tão sombrio assim — pelo menos não em um futuro próximo — pois, como aponta, existe uma “escassez de talentos em cibersegurança”. Segundo ele, uma das perguntas mais comuns feitas a ele por pessoas que estão começando a empregar robôs na segurança é o que fazer com os profissionais que a inteligência artificial vai ser capaz de substituir.

Apesar de defender as vantagens dessas máquinas, McClure lembra que estes sistemas não são o que é chamado na computação de “bala de prata” — ou seja, não solucionam todos os problemas. “Nossa instrução nesses casos é empregar essas pessoas para proteger o 0,1% que esta tecnologia não cobriria, esses especialistas teriam que correr atrás de um número bem reduzido de ocorrências e com isso ir atrás de resolver as coisas realmente difíceis: os ataques vindo de outros países, ataques feitos utilizando outras inteligências artificiais e coisas do gênero.”